百度是全球最大的中文搜索引擎,每天有数亿的网站被百度蜘蛛抓取。对于网站运营者来说,了解百度蜘蛛的行为和优化技巧是至关重要的,这可以帮助他们优化网站,提升在搜索结果中的排名,从而带来更多的流量和收益。

蜘蛛的工作原理

百度蜘蛛是一种程序,它会自动访问互联网上的网站,并将网站上的内容抓取下来,存储到百度的数据库中。蜘蛛会根据链接爬行整个互联网,并将其发现的新链接添加到队列中,以进行下一轮的抓取。蜘蛛会定期回访网站,以更新其存储的信息。

蜘蛛的行为特点

百度蜘蛛会根据网站的质量、更新频率和页面排名等因素进行抓取,同时还会考虑页面中的关键词密度和内部链接结构等因素。如果网站的质量不好,或者页面不符合百度的算法标准,那么蜘蛛可能会忽略该网站,或者将其排名降低。

如何让蜘蛛更好地抓取网站

要想让蜘蛛更好地抓取网站,首先要保证网站质量良好,内容丰富、更新频率高,并且有清晰的内部链接结构。要确保网站的关键词密度和页面标题等元素符合百度的算法标准。要让蜘蛛更容易抓取网站,可以通过设置robots.txt文件和sitemap.xml文件来指导蜘蛛抓取。

如何避免蜘蛛降低排名

如果蜘蛛发现网站存在大量的垃圾链接、重复内容和恶意行为等问题,那么可能会降低该网站在搜索结果中的排名。为了避免这种情况的发生,网站运营者应该及时清理垃圾链接、删除重复内容,并且避免使用恶意SEO技术来欺骗蜘蛛。

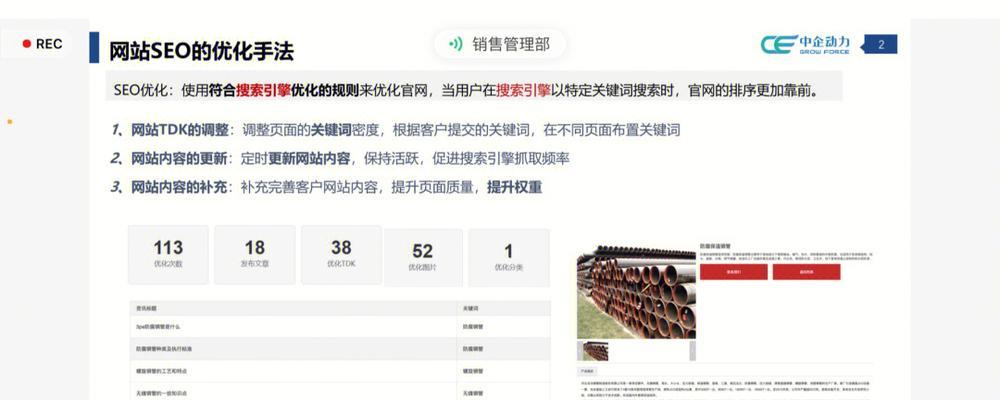

如何优化网站以符合百度算法

为了让网站符合百度算法标准,可以采取一系列优化措施,包括关键词研究、合理使用标题和描述、优化图片和视频等内容,以及合理设置内部链接结构。还可以通过提高网站的访问速度和安全性来提升网站的质量。

如何监测蜘蛛的行为

网站运营者可以通过百度站长工具或其他SEO工具来监测蜘蛛的抓取情况。这些工具可以提供详细的数据分析和报告,以帮助运营者了解蜘蛛的抓取行为,并及时发现网站存在的问题。

如何利用蜘蛛的抓取行为做SEO

利用蜘蛛的抓取行为进行SEO优化可以带来很好的效果。具体来说,可以通过合理设置关键词和页面标题等元素来引导蜘蛛对网站进行更好的抓取,并且可以利用内部链接结构来提高网站的权重和排名。

如何避免蜘蛛误判网站

有时候,蜘蛛可能会误判网站,将其排名降低甚至直接忽略。为了避免这种情况,网站运营者应该避免使用黑帽SEO技术和其他恶意行为,同时需要保证网站的质量和内容水平。

如何处理蜘蛛抓取出现的问题

当网站被百度蜘蛛抓取时,有时候会出现一些问题,例如页面404、重定向错误、超时等。为了解决这些问题,可以通过检查网站代码和日志来找出问题的原因,并及时修复。

如何利用蜘蛛抓取数据做SEO优化

利用蜘蛛抓取数据可以帮助运营者了解网站的访问情况和用户行为,从而进行更好的SEO优化。具体来说,可以通过分析蜘蛛抓取日志来找出用户喜欢的内容和关键词,以及发现网站存在的问题并及时修复。

蜘蛛抓取的频率和速度

百度蜘蛛抓取网站的频率和速度会受到很多因素的影响,包括网站的质量、更新频率、内部链接结构、页面排名等因素。一般来说,大型网站被抓取的频率会更高,而小型网站则需要通过其他方法来吸引蜘蛛。

如何利用蜘蛛抓取日志做数据分析

通过分析蜘蛛抓取日志,可以了解网站的访问情况、用户行为和搜索趋势等信息,从而进行更好的数据分析和SEO优化。具体来说,可以通过分析蜘蛛抓取的URL、IP地址和HTTP状态码等信息,来了解网站的访问情况和用户需求。

蜘蛛抓取的影响因素

百度蜘蛛抓取网站的时候,会受到很多因素的影响,包括页面质量、内部链接结构、关键词密度、页面标题和描述等元素。同时,还会受到页面更新频率、访问速度、安全性等因素的影响。

蜘蛛抓取的变化趋势

随着搜索引擎技术的不断发展,百度蜘蛛的抓取方式和策略也在不断改变。目前,百度蜘蛛更加注重网站的质量和内容水平,对于低质量、恶意网站的惩罚力度也在不断加大。

了解百度搜索引擎蜘蛛的行为和优化技巧,对于网站运营者来说是非常重要的。通过合理的优化和监测,可以让蜘蛛更好地抓取网站,提高网站在搜索结果中的排名和流量。同时,还需要避免使用恶意行为和黑帽SEO技术,保证网站的质量和内容水平。

暂无评论内容